在数字化浪潮中,用户行为数据已成为驱动产品迭代、精准营销与业务决策的核心燃料。面对每日高达20亿条数据的洪流,如何构建一个稳定、高效、可扩展的实时处理与分析服务系统,是技术团队面临的关键挑战。本文将分享一套经过实践检验的高性能实时用户行为服务系统架构,涵盖从数据采集、传输、处理到存储与服务的全链路设计。

一、 架构设计核心目标与挑战

系统设计之初,我们明确了三大核心目标:高吞吐、低延迟、高可用。具体挑战包括:

- 海量数据写入:日均20亿,峰值QPS可达百万级。

- 复杂实时计算:需在毫秒至秒级完成用户行为路径分析、事件聚合、异常检测等。

- 数据一致性:确保在分布式环境下处理结果的准确性与时效性。

- 系统弹性:能够应对流量洪峰与硬件故障,平滑扩展。

二、 整体架构分层解析

系统采用典型的Lambda架构思想,融合实时与批处理流,确保数据的完整性与实时性。主要分为四层:

1. 数据采集与接入层

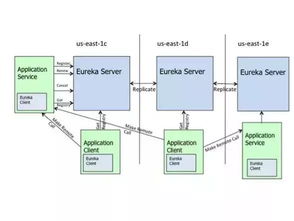

客户端(Web/App/小程序)通过轻量级SDK埋点,将行为日志压缩后,通过HTTP/2协议发送至全球负载均衡(GLB) 后的网关集群。网关负责鉴权、限流、协议转换,并将数据异步写入Kafka消息队列。Kafka作为系统的“数据总线”,其高吞吐、持久化的特性完美承接了流量洪峰,实现了生产与消费的解耦。

2. 实时计算层(速度层)

这是系统的“心脏”。我们选用Apache Flink作为实时计算引擎。Flink消费Kafka中的数据,通过其强大的窗口(Window)、状态(State)管理和CEP(复杂事件处理)能力,实时处理核心业务逻辑:

- 实时ETL:清洗、格式化、补充用户与设备上下文。

- 实时聚合:按用户、会话、事件类型等维度,秒级生成UV、PV、转化漏斗等指标。

- 实时特征计算:为推荐、风控等下游系统提供用户实时兴趣向量。

计算结果被分别写入OLAP数据库(如ClickHouse)用于即时查询,以及Redis集群用于毫秒级在线服务(如用户最近行为查询)。

3. 批量计算与存储层(批处理层)

为确保数据的最终一致性与历史深度分析,我们保留了批处理管道。每日凌晨,通过Apache Spark或Flink Batch模式,从Kafka的备份存储(如HDFS)或数据湖中读取全量数据,进行复杂的离线计算、数据校正与模型训练,产出T+1的精准报表与用户画像,存入Hive或数据湖,并通过Presto/Trino提供即席查询。

4. 数据服务与应用层

通过统一的数据服务API网关对外提供数据服务。根据查询的实时性要求,网关路由请求:

- 对实时性要求极高的查询(如反欺诈实时判定),直接访问Redis或Flink直接输出的流式接口。

- 对近实时或交互式分析查询,路由至ClickHouse集群,其列式存储与向量化引擎可支撑亚秒级的多维分析。

- 对复杂的历史数据关联查询,则路由至Presto查询数据湖。

前端仪表盘、推荐系统、告警系统等应用通过调用这些API获取数据。

三、 关键优化实践

- 资源与性能优化:对Flink作业进行细粒度调优,包括合理设置并行度、利用 RocksDB状态后端、开启增量检查点以降低对吞吐的影响,并采用本地KeyGroup分配策略减少网络Shuffle。

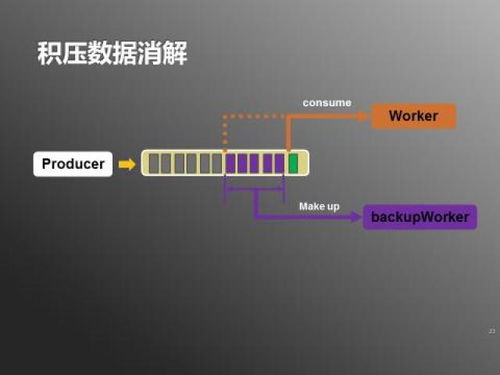

- 稳定性保障:全链路实现监控与告警(如Prometheus + Grafana),对Kafka积压、Flink Checkpoint失败、服务延迟等关键指标进行监控。建立分级保障与降级策略,在核心组件故障时,可暂时降级为仅提供关键指标的准实时服务。

- 数据质量治理:在ETL环节加入数据质量校验规则(如非空校验、枚举值校验),并将异常数据导入死信队列(Dead Letter Queue)供人工排查,确保进入下游的数据可信。

- 成本控制:对冷热数据进行分层存储,近期热数据存于SSD,历史数据归档至对象存储(如S3/OSS)。根据业务周期弹性伸缩计算资源,在流量低谷时自动缩容。

四、 与展望

这套以Kafka+Flink+ClickHouse为核心,结合批流一体的架构,在实践中成功支撑了日均20亿数据量的实时处理与分析,端到端延迟稳定在秒级以内。架构演进将着眼于:

- 向真正的流批一体(如Flink Table API/SQL的统一) 演进,简化开发与运维成本。

- 探索数据湖仓一体化,在保证实时性的进一步提升数据治理的灵活性与效率。

- 深化AI驱动的智能运维,实现集群资源的更精准预测与弹性调度。

实时用户行为数据系统的建设是一场持续的马拉松,而非一次性的冲刺。它要求架构师在吞吐、延迟、成本与复杂度之间不断寻求最佳平衡,并以高度的灵活性与可观测性应对未来业务的未知挑战。